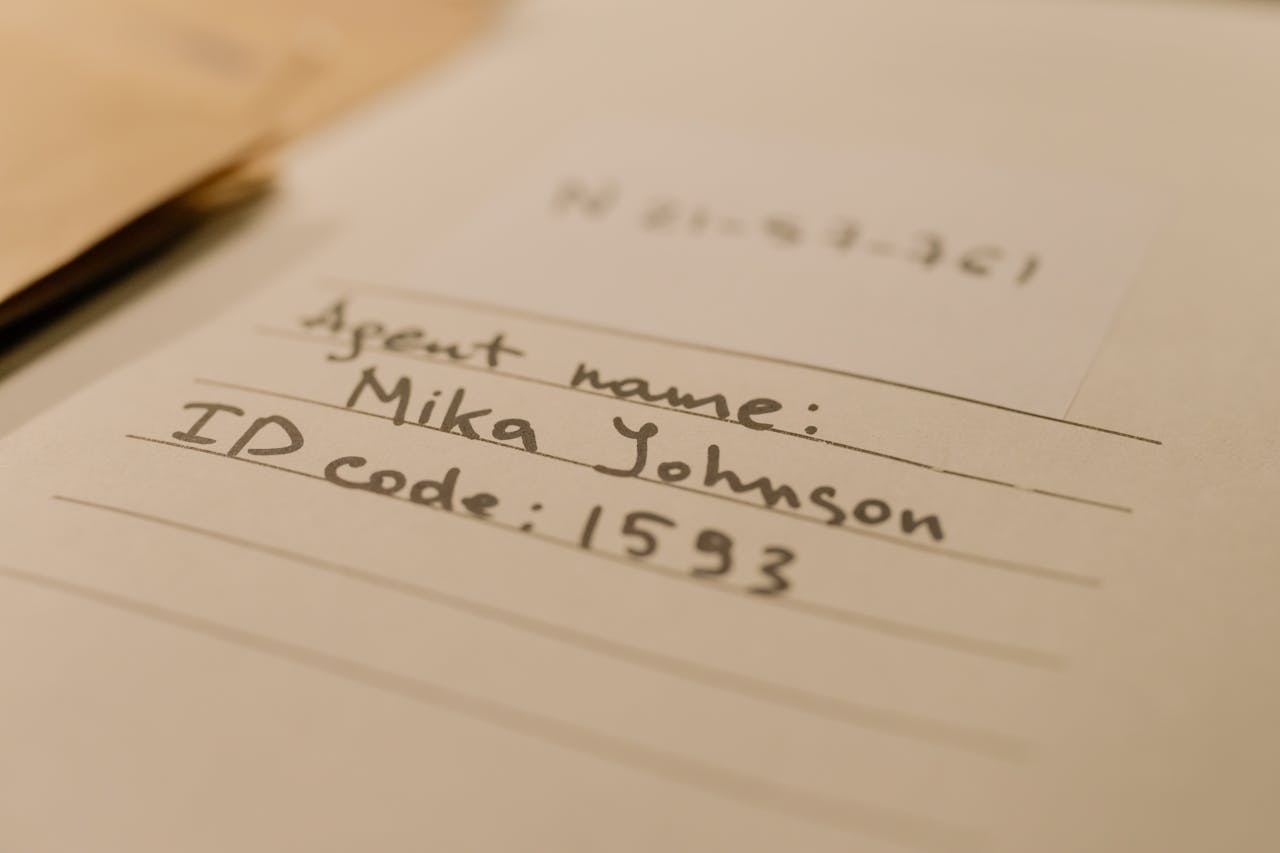

Autonome AI-agents nemen steeds vaker zelfstandig taken over: van het verzenden van e-mails tot het ophalen van rapportages of uitvoeren van scripts. Dat levert efficiëntie op, maar stelt ook nieuwe eisen aan beveiliging. Want hoe weet je zeker dat een AI-agent betrouwbaar is? Wie beheert zijn toegangsrechten? En wat als hij gehackt wordt? In dit artikel leggen we uit waarom het beheren van AI-identiteiten onmisbaar wordt in de digitale beveiligingsstrategie van elke organisatie.